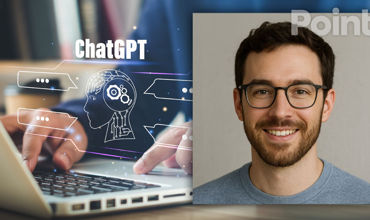

Când i se cere să se deseneze pe sine în formă umană, inteligența artificială ChatGPT-4o generează în mod constant imaginea unui tânăr de culoare albă, cu păr șaten, barbă și ochelari. Un astfel de portret este produs indiferent de stil, fie că este vorba de o manga, o carte de benzi desenate, o pictură medievală sau o carte de Tarot. Stilul variază, dar chipul rămâne același, scrie naukatv.ru.

Primul care a observat acest lucru a fost cercetătorul în inteligență artificială Daniel Paleka care și-a împărtășit observațiile pe platforma Substack. El i-a rugat lui ChatGPT să se deseneze în diferite genuri și peste tot a primit același bărbat „standard” convențional, o figură care poate fi imaginată rătăcind pe străzile din Brooklyn sau în Silicon Valley, amestecându-se pe fundalul urban.

Potrivit lui Paleka, aceasta ar putea fi o alegere conștientă a OpenAI de a evita generarea de oameni reali, o glumă internă a echipei de dezvoltare sau un efect secundar al datelor de formare în care o astfel de imagine este mai des asociată cu „omul standard”.

Deși ChatGPT nu are conștiință de sine, alegerea aceluiași arhetip, un bărbat tânăr alb, nu poate fi considerată aleatorie. Istoria inteligenței artificiale a ridicat în mod repetat probleme legate de prejudecăți. Algoritmii de recunoaștere facială greșesc mai des în cazul persoanelor cu pielea închisă la culoare, sistemele predictive din justiție demonstrează discriminare rasială, iar modelele lingvistice perpetuează stereotipurile sexiste.

Potrivit autorului articolului, „LLM este o oglindă care reflectă atât utilizatorul, cât și programatorul. Este un calculator de cuvinte, nu de conștiință”. Totuși, în aceste imagini și răspunsuri „aleatorii” pot fi văzute urme ale culturii pe care sunt construite modelele.

Imaginea „tânărului brunet cu ochelari” nu este poate nimic mai mult decât rezultatul statisticii în date. Dar aceasta remintește că până și asistenții digitali au propriile lor urme culturale. Și acestea sunt mult mai profunde decât par la prima vedere.

Acum ne puteți urmări și pe Telegram, Facebook și Instagram pentru a fi la curent cu ultimele știri.

Un oraș. O coloană. O dragoste — VeloHora 2025 by Skoda!

Un oraș. O coloană. O dragoste — VeloHora 2025 by Skoda!