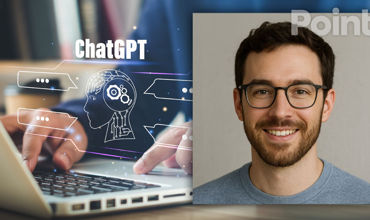

При просьбе нарисовать себя в человеческом обличии она стабильно генерирует образ молодого белого мужчины с каштановыми волосами, бородкой и очками. Такой портрет выдается независимо от стилистики — будь то манга, комикс, живопись средневековья или карта Таро. Стиль варьируется, но лицо остается прежним, пишет naukatv.ru

Первым это заметил исследователь ИИ Дэниел Палека и поделился наблюдениями на платформе Substack. Он попросил ChatGPT нарисовать себя в разных жанрах, и везде получал одного и того же условно «стандартного» мужчину — образ, который можно представить бродящим по улицам Бруклина или в Кремниевой долине, сливающимся с городским фоном.

По словам Палеки, это может быть сознательный выбор OpenAI, чтобы избежать генерации реальных людей, внутренняя шутка команды разработчиков или побочный эффект обучающих данных, где такой образ чаще всего ассоциируется с «человеком по умолчанию».

И хотя ChatGPT не обладает самосознанием, выбор им одного и того же архетипа — белого молодого мужчины — нельзя считать случайным. В истории ИИ не раз поднимались вопросы о предвзятости: алгоритмы распознавания лиц ошибаются чаще на темнокожих людях, предсказательные системы в правосудии демонстрируют расовую дискриминацию, а языковые модели закрепляют сексистские стереотипы.

По словам автора статьи, «LLM — это зеркало, которое отражает и пользователя, и программиста. Это калькулятор слов, а не сознание». Тем не менее именно в этих «случайных» образах и ответах видны следы культуры, на которой построены модели.

Образ «молодого шатена в очках» — возможно, не более чем результат статистики в данных. Но он напоминает: даже у цифровых ассистентов есть свои культурные следы. И они куда глубже, чем кажется на первый взгляд.

В Чимишлии проводились собачьи бои: полиция проводит расследование

В Чимишлии проводились собачьи бои: полиция проводит расследование